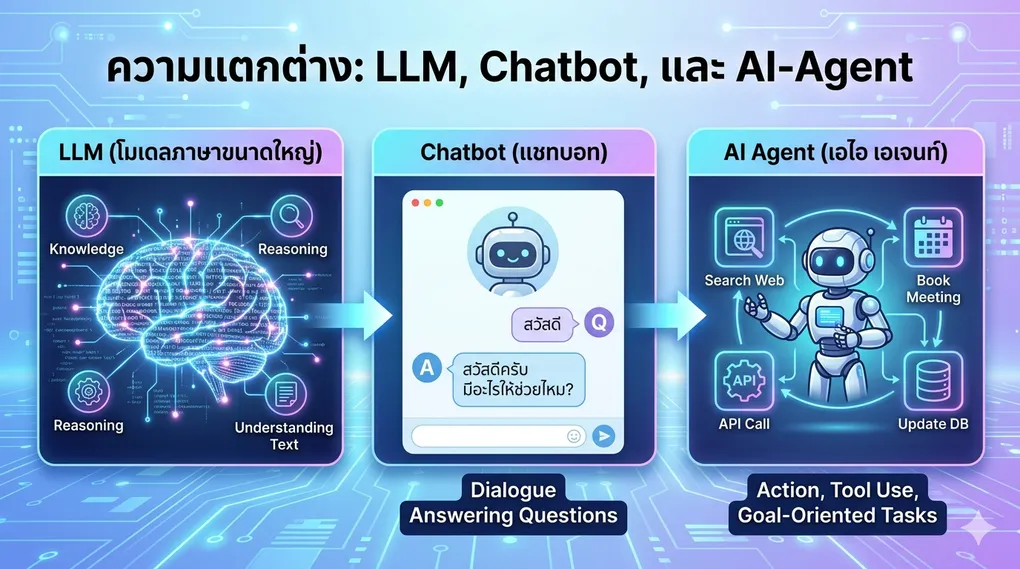

AI Agent คืออะไร? พื้นฐาน LLM และ Tool Calling

Level 0 — เริ่มต้นเข้าใจ AI Agent ตั้งแต่พื้นฐาน: LLM, Chatbot(Generative AI), และ Tool Calling

สำหรับใคร: ผู้ที่เริ่มต้นศึกษา AI Agent ตั้งแต่ศูนย์ เป้าหมาย: เข้าใจว่า LLM คืออะไร, Chatbot ต่างจาก AI Agent ยังไง, และ Tool Calling คืออะไร

📚 บทความนี้เป็นส่วนหนึ่งของ series Multi-Agent Foundation แนะนำให้อ่านตามลำดับ Level 0 → 1 → 2 → 3

ก่อนเริ่ม — ทำไมต้องเรียนเรื่องนี้?

ลองนึกภาพนี้…

คุณขอให้ ChatGPT “จองโต๊ะร้านอาหารให้หน่อยนะ คืนนี้ 2 คน”

ChatGPT ตอบกลับมาว่า:

“แน่นอนครับ! คุณสามารถโทรจองได้ที่เบอร์ 02-xxx-xxxx หรือเข้าไปจองผ่านเว็บไซต์…”

แต่ถ้าเป็น AI Agent ที่ดีกว่านั้น มันจะ ลงมือจองให้จริงๆ เลย แล้วรายงานกลับมาว่า “จองแล้วครับ โต๊ะ 2 ที่ เวลา 19:00 น. ยืนยันแล้ว”

นั่นแหละคือความแตกต่างที่เราจะเรียนในวันนี้

1. LLM คืออะไร และทำงานยังไง?

ถ้าพูดว่า “LLM” หลายคนนึกถึง ChatGPT หรือ Claude ทันที แต่จริงๆ แล้ว LLM คือ เครื่องมือชิ้นหนึ่ง ข้างในนั้น — ไม่ใช่ตัว app ทั้งหมด

แล้ว LLM คืออะไรกันแน่?

ลองนึกภาพนักแปลที่อ่านหนังสือมาทั้งชีวิต

ลองนึกภาพ คนแปลภาษา ที่ใช้เวลาทั้งชีวิตอ่านหนังสือทุกประเภทบนโลกนี้ ตั้งแต่วิกิพีเดีย, นิยาย, ตำรา, ข่าว, โค้ดโปรแกรม ไปจนถึงสูตรอาหาร

เขาอ่านมาเยอะมากจนเริ่มเข้าใจว่า “ถ้าคนพูดประโยคแบบนี้ คำต่อไปที่น่าจะพูดคืออะไร”

พอเราถามอะไรเขาไป เขาก็ใช้ความรู้ทั้งหมดที่สะสมมา ตอบกลับออกมาเป็นคำๆ ทีละคำ

LLM ทำงานแบบเดียวกันเลย — แค่แทนที่ “คนแปล” ด้วย “โมเดลทางคณิตศาสตร์ขนาดยักษ์” และแทนที่ “อ่านหนังสือ” ด้วย “เรียนรู้จาก text บนอินเทอร์เน็ตมหาศาล”

LLM คืออะไร?

LLM = Large Language Model แปลตรงๆ ว่า “โมเดลภาษาขนาดใหญ่”

มันคือโปรแกรม AI ที่ถูก “เทรน” ด้วยข้อความจำนวนมหาศาล จนสามารถ:

- เข้าใจภาษามนุษย์

- สร้างข้อความที่สมเหตุสมผล

- ตอบคำถาม, สรุปเนื้อหา, เขียนโค้ด, แปลภาษา ฯลฯ

ตัวอย่าง LLM ที่รู้จักกัน:

- GPT-4o (OpenAI) — อยู่ข้างใน ChatGPT

- Claude (Anthropic) — ตัวที่คุณกำลังใช้อยู่

- Gemini (Google)

- Llama (Meta) — open source

ทำงานยังไง? — Token by Token

สิ่งที่สำคัญมากที่ต้องเข้าใจคือ LLM ไม่ได้ “คิด” ทั้งหมดก่อนแล้วค่อยพิมพ์ออกมา

มัน สร้างคำตอบทีละ token โดยแต่ละ token ที่สร้างออกมา จะกลายเป็น input สำหรับ token ถัดไป

💡 Token คืออะไร? Token ไม่ใช่คำเต็มๆ เสมอไป — มันคือ “ชิ้นส่วนของข้อความ” เช่น คำว่า “สวัสดี” อาจเป็น 1–2 token, คำว่า “Transformer” อาจเป็น 1 token ในภาษาอังกฤษ ลองนึกว่า 1 token ≈ ¾ ของคำ ในภาษาอังกฤษ

วิธีที่ LLM ตอบคำถาม

คำถาม: "ท้องฟ้าสีอะไร?"

│

▼

┌─────────────┐

│ LLM │ ← รับ input ทั้งหมดพร้อมกัน

└─────────────┘

│

▼ สร้างทีละ token

"ท้อง" → "ฟ้า" → "สี" → "น้ำ" → "เงิน" → "ครับ"

ผลลัพธ์: "ท้องฟ้าสีน้ำเงินครับ"สิ่งที่ LLM ทำได้ และทำไม่ได้

| ทำได้ ✅ | ทำไม่ได้ ❌ |

|---|---|

| ตอบคำถาม, อธิบาย, สรุป | เข้าเว็บ, เช็คราคา realtime |

| เขียนโค้ด, แก้บั๊ก | ส่ง email, สั่งซื้อของ |

| แปลภาษา, ปรับแต่งข้อความ | จำการสนทนาข้าม session ได้ (โดย default) |

| วิเคราะห์ข้อมูลที่ส่งให้ | รู้เรื่องที่เกิดขึ้นหลังจากถูก train |

❗ จุดสำคัญ: LLM คือ “สมอง” — แต่มันไม่มี “มือ” ไม่มี “ตา” มองโลกภายนอก และไม่มี “ความจำ” ระหว่าง session

นั่นคือเหตุผลที่เราต้องการ “AI Agent” ซึ่งจะพูดถึงในหัวข้อต่อไป

✅ Check Your Understanding — หัวข้อที่ 1

ลองตอบคำถามเหล่านี้ในใจก่อนอ่านต่อ:

- LLM ย่อมาจากอะไร และมันคืออะไร?

- LLM สร้างคำตอบทีละอะไร? (คำตอบไม่ใช่ “ประโยค”)

- ยกตัวอย่าง LLM มา 2 ตัว

- ทำไม LLM ถึงไม่สามารถเช็คราคาหุ้น realtime ได้?

เฉลย (คลิกเพื่อดู)

- LLM = Large Language Model — โมเดลทางคณิตศาสตร์ที่เรียนรู้จากข้อความมหาศาลจนสามารถเข้าใจและสร้างภาษาได้

- LLM สร้างคำตอบ ทีละ token (ชิ้นส่วนของข้อความ)

- เช่น GPT-4o, Claude, Gemini, Llama

- เพราะ LLM ไม่มี “เครื่องมือ” ที่จะออกไปดึงข้อมูล realtime — มันรู้แค่สิ่งที่เรียนรู้มาตอน train เท่านั้น

2. Chatbot(Generative AI) กับ AI Agent ต่างกันยังไง?

ลองนึกถึงสถานการณ์นี้:

คุณ: “ช่วยวางแผนทริปเชียงใหม่ 3 วัน 2 คืน แล้วจองให้ด้วยนะ”

Chatbot ตอบ:

“แน่นอน! นี่คือแผนทริปเชียงใหม่ 3 วัน 2 คืน: วันที่ 1: ดอยสุเทพ, ไนท์บาซาร์… (แผนยาว 500 คำ) สำหรับการจอง คุณสามารถเข้าไปที่ Agoda.com…”

AI Agent ตอบ:

“กำลังดำเนินการครับ… ✅ เช็คโรงแรมราคาดีที่สุดสำหรับวันที่ 15–17 มี.ค. แล้ว ✅ จองโรงแรม The Chiang Mai แล้ว ราคา 1,200 บาท/คืน ✅ สร้าง Google Calendar event แล้ว ✅ ส่ง confirmation ไปที่ email คุณแล้ว

พร้อมออกเดินทางเลยครับ!”

ความแตกต่างชัดมาก — Chatbot บอกวิธีทำ, AI Agent ลงมือทำ

Chatbot เหมือนที่ปรึกษา — AI Agent เหมือนผู้ช่วยส่วนตัว

| ที่ปรึกษา (Consultant) | ผู้ช่วยส่วนตัว (Personal Assistant) | |

|---|---|---|

| เมื่อคุณถาม | ให้คำแนะนำ วิธีทำ | ลงมือทำให้ |

| ผลลัพธ์ | ความรู้และแผน | งานที่เสร็จแล้ว |

| ตัวอย่าง | ”คุณควรโทรหาธนาคาร แล้วพูดว่า…" | "โทรให้แล้วครับ นัดไว้วันพรุ่งนี้ 10 โมง” |

Chatbot = ที่ปรึกษา AI Agent = ผู้ช่วยส่วนตัว

ความแตกต่างระหว่าง Chatbot กับ AI Agent

CHATBOT

─────────────────────────────────────────────

คุณ ──► [คำถาม] ──► LLM ──► [คำตอบ] ──► คุณ

• รับ input → สร้าง output → จบ

• ไม่มีการ "ทำอะไร" กับโลกภายนอก

• เหมือนการ "ถาม-ตอบ" ธรรมดา

AI AGENT

─────────────────────────────────────────────

คุณ ──► [เป้าหมาย] ──► Agent

│

┌─────────┼─────────┐

▼ ▼ ▼

[LLM] [Tools] [Memory]

คิด ทำ จำ

│ │ │

└─────────┼─────────┘

│

วนซ้ำจน

งานเสร็จ

│

▼

รายงานผล ──► คุณ

• รับ เป้าหมาย → วางแผน → ใช้ tools → ทำซ้ำ → จบ

• สามารถ "กระทำ" กับโลกภายนอกได้จริงสรุปความต่าง 3 มิติ

มิติที่ 1 — Input vs Goal

| Chatbot | AI Agent | |

|---|---|---|

| รับ input แบบ | คำถาม / คำสั่ง | เป้าหมาย |

| ตัวอย่าง | ”อธิบายการจอง Agoda ให้หน่อย" | "จองโรงแรมที่เชียงใหม่ให้หน่อย” |

| ผลลัพธ์ | ข้อความอธิบาย | งานที่เสร็จจริง |

มิติที่ 2 — Reactive vs Proactive

Chatbot — ตอบสนองทีละครั้ง

─────────────────────────────

[คำถาม 1] → [ตอบ 1] → จบ

[คำถาม 2] → [ตอบ 2] → จบ

AI Agent — วางแผนและทำเองหลายขั้น

────────────────────────────────────

[เป้าหมาย] → คิด → ทำ → คิด → ทำ → คิด → ทำ → รายงาน

▲ │

└───────────────────────────────┘

วนลูปจนงานเสร็จมิติที่ 3 — เครื่องมือ (Tools)

AI Agent มี “มือ” ที่ใช้ทำงานได้จริง เช่น:

- 🔍 ค้นหาข้อมูลบนอินเทอร์เน็ต

- 📧 ส่ง email

- 📅 สร้าง calendar event

- 💾 อ่าน/เขียนไฟล์

- 🌐 เข้าเว็บไซต์

- 🛒 สั่งซื้อสินค้า

Chatbot ไม่มีเครื่องมือเหล่านี้ — มันทำได้แค่ “พูด”

ตัวอย่างที่จับต้องได้

ตัวอย่างที่ 1 — Research งาน

| Chatbot | AI Agent | |

|---|---|---|

| คำสั่ง | ”อธิบาย trend AI ปี 2025 ให้หน่อย" | "รีเสิร์ช trend AI ปี 2025 แล้วสรุปเป็น report ให้หน่อย” |

| สิ่งที่ทำ | ใช้ความรู้ที่มีอยู่ตอบ | ค้นเว็บ → อ่านบทความ → สรุป → สร้างไฟล์ |

| ผลลัพธ์ | ข้อความตอบกลับ | ไฟล์ report.pdf ในคอมของคุณ |

ตัวอย่างที่ 2 — จัดการ email

| Chatbot | AI Agent | |

|---|---|---|

| คำสั่ง | ”ช่วยร่าง email ตอบลูกค้าให้หน่อย" | "ตอบ email ลูกค้าทุกคนที่รอตอบอยู่ให้หน่อย” |

| สิ่งที่ทำ | เขียน draft ให้คุณ copy | เปิด inbox → อ่าน email → เขียนตอบ → ส่ง |

| ผลลัพธ์ | ข้อความ draft | email ส่งแล้วทุกฉบับ |

✅ Check Your Understanding — หัวข้อที่ 2

- ความแตกต่างหลักระหว่าง Chatbot กับ AI Agent คืออะไร? (ตอบด้วยคำเดียวหรือวลีสั้นๆ)

- ถ้าคุณพิมพ์ว่า “อธิบายวิธีจองตั๋วเครื่องบิน” — นี่คือการใช้งานแบบ Chatbot หรือ AI Agent?

- AI Agent ต่างจาก Chatbot ใน 3 มิติอะไรบ้าง?

- ลอง list ตัวอย่างงาน 3 อย่าง ที่ต้องใช้ AI Agent แทน Chatbot

เฉลย (คลิกเพื่อดู)

- AI Agent ลงมือทำได้จริง โดยใช้ tools — Chatbot แค่ตอบด้วยข้อความ

- Chatbot — คุณแค่ถามขอคำอธิบาย ไม่ได้ให้มันจองจริงๆ

- สามมิติ: Input (คำถาม vs เป้าหมาย), Reactive vs Proactive, ไม่มี vs มี Tools

- เช่น: จองโรงแรม, ตอบ email อัตโนมัติ, รวบรวม data จากหลายเว็บ ฯลฯ

3. Tool Calling และ Function Calling คืออะไร?

ตอนนี้คุณรู้แล้วว่า AI Agent ต่างจาก Chatbot เพราะมัน “ทำได้จริง”

แต่คำถามคือ… มันทำได้ยังไง?

LLM คือ “สมอง” ที่อยู่ข้างใน — แต่มันเองก็ตอบได้แค่ “ข้อความ” เช่นกัน

ความลับอยู่ที่ Tool Calling (หรือบางที่เรียกว่า Function Calling)

LLM เหมือนเลขานุการ ที่เปิดโปรแกรมต่างๆ จัดการงานเอง

ลองนึกถึงเลขานุการที่รับคำสั่งจากนาย แล้วลงมือจัดการเอง

สถานการณ์: นายสั่ง "หาราคาตั๋วเครื่องบินไปเชียงใหม่ แล้วส่งให้ทีมด้วย"

เลขานุการคิดว่า: "ต้องหาข้อมูลราคาก่อน"

→ เปิด Google แล้วค้นหา

→ ในโลก LLM คือ: เรียก Tool search_web("ราคาตั๋วเชียงใหม่")

→ ได้ผล: "ราคาเริ่มต้น 1,200 บาท สายการบิน A"

เลขานุการคิดว่า: "ได้ข้อมูลแล้ว ต้องส่งให้ทีมต่อ"

→ เปิด Gmail แล้วพิมพ์และส่ง

→ ในโลก LLM คือ: เรียก Tool send_email("ราคาตั๋วเชียงใหม่ เริ่มต้น 1,200 บาท...")

→ ได้ผล: "ส่ง email แล้ว"

เลขานุการคิดว่า: "บันทึกไว้ด้วยดีกว่า"

→ เปิด Calendar แล้วสร้างนัด

→ ในโลก LLM คือ: เรียก Tool create_event("เช็คราคาตั๋วเชียงใหม่")

→ ได้ผล: "สร้างนัดแล้ว"LLM ทำงานแบบเดียวกัน — คิดว่าต้องทำอะไร → เลือก tool ที่เหมาะ → เรียกใช้ → รับผลกลับมา → คิดต่อ

โปรแกรมไม่มีความคิดเอง — เลขานุการกดเปิดแล้วได้ผลกลับมาเลย เหมือน tool ที่ LLM เรียกแล้วรันทันที

Tool Calling ทำงานยังไง? — ทีละ Step

Tool Calling คือกระบวนการที่ LLM สามารถ “เรียกใช้ฟังก์ชัน” ที่นักพัฒนาเตรียมไว้ให้

กระบวนการ Tool Calling แบบง่าย

Step 1: Developer เตรียม Tools

────────────────────────────────

นักพัฒนา define tools เช่น:

search_web(query: string) → ค้นหาบนอินเทอร์เน็ต

send_email(to, subject, body) → ส่ง email

get_weather(city: string) → เช็คสภาพอากาศ

create_file(name, content) → สร้างไฟล์

Step 2: User ถามคำถาม

────────────────────────────────

User: "อากาศกรุงเทพวันนี้เป็นยังไงบ้าง?"

Step 3: LLM ตัดสินใจ

────────────────────────────────

LLM คิดว่า: "ฉันต้องการข้อมูล realtime

ฉันมี tool ชื่อ get_weather อยู่

ควรเรียกใช้มัน"

LLM ส่งออกมา:

{

"tool": "get_weather",

"city": "Bangkok"

}

Step 4: System รัน Tool จริง

────────────────────────────────

System เรียก API สภาพอากาศจริงๆ

ได้ผลลัพธ์: "35°C, ฟ้าแจ่ม, ความชื้น 70%"

Step 5: ส่งผลกลับให้ LLM

────────────────────────────────

ส่ง: "ผลจาก get_weather: 35°C, ฟ้าแจ่ม..."

Step 6: LLM ตอบ User

────────────────────────────────

LLM: "วันนี้กรุงเทพอากาศร้อน 35°C ฟ้าแจ่ม

ความชื้นสูงหน่อยนะครับ แนะนำใส่เสื้อบาง"ภาพรวม Tool Calling แบบสมบูรณ์

USER

│

│ "อากาศวันนี้เป็นยังไง?"

▼

┌──────────────────────────────────────┐

│ AGENT │

│ │

│ ┌──────────┐ ┌──────────────┐ │

│ │ LLM │────►│ Tool Call │ │

│ │ (คิด) │◄────│ get_weather │ │

│ └──────────┘ └──────┬───────┘ │

│ │ │

└───────────────────────────│──────────┘

│ เรียกจริง

▼

┌─────────────────┐

│ Weather API │

│ (โลกภายนอก) │

└─────────────────┘

│

"35°C, ฟ้าแจ่ม"

│

▼ ส่งกลับ

┌───────────────────────────────┐

│ LLM รับผล แล้วตอบ User │

└───────────────────────────────┘

│

▼

USER ◄──── "วันนี้อากาศร้อน 35°C..."💡 Key Insight: LLM เองไม่ได้ทำอะไรกับโลกภายนอก — มันแค่ ตัดสินใจว่าจะเรียก tool ไหน และ ใช้ผลลัพธ์ที่ได้มาตอบ ส่วนการรัน tool จริงๆ เป็นหน้าที่ของโค้ดรอบนอก

ตัวอย่างที่จับต้องได้ — Agent จองร้านอาหาร

สมมติว่ามี AI Agent ที่มี tools เหล่านี้:

search_restaurants(location, cuisine)— ค้นหาร้านอาหารcheck_availability(restaurant_id, date, people)— เช็คที่ว่างmake_reservation(restaurant_id, date, people, name)— จองโต๊ะsend_confirmation(email, details)— ส่ง confirmation

เมื่อคุณพูดว่า “จองร้านอาหารอิตาลีใกล้สีลม คืนนี้ 2 คน”

Agent ทำงาน:

1. LLM คิด: "ต้องหาร้านก่อน"

→ เรียก search_restaurants("สีลม", "อิตาลี")

→ ได้ผล: [La Piazza, Pizza Mia, Trattoria Roma]

2. LLM คิด: "ต้องเช็คที่ว่าง"

→ เรียก check_availability("la_piazza", "today", 2)

→ ได้ผล: "มีที่ว่าง 19:00 และ 20:30"

3. LLM คิด: "เจอร้านที่โอเค จองเลย"

→ เรียก make_reservation("la_piazza", "19:00", 2, "คุณ")

→ ได้ผล: "จองสำเร็จ ref #A123"

4. LLM คิด: "ส่ง confirmation ให้ user"

→ เรียก send_confirmation(user_email, "La Piazza 19:00...")

→ ได้ผล: "ส่งแล้ว"

5. LLM ตอบ User:

"จองแล้วครับ! La Piazza เวลา 19:00 น.

2 ที่นั่ง ยืนยันแล้ว ส่ง email ไปให้แล้ว 🍝"นี่คือพลังของ Tool Calling — LLM ทำหน้าที่ “คิดและวางแผน” ส่วน tools ทำหน้าที่ “ลงมือทำ”

ทำไมต้องแยก “คิด” กับ “ทำ”?

เหตุผลที่ออกแบบแบบนี้มีความสมเหตุสมผลมาก:

1. ความยืดหยุ่น LLM เดิมที่เทรนมาแล้วสามารถใช้ tool ใหม่ได้เสมอ โดยไม่ต้องเทรนใหม่

2. ความปลอดภัย นักพัฒนาควบคุมได้ว่า Agent มี “มือ” ทำอะไรได้บ้าง — จะไม่ให้จ่ายเงินได้ก็แค่ไม่ใส่ tool payment

3. ความน่าเชื่อถือ Tool เป็น code จริงๆ — ผลลัพธ์แม่นยำ ไม่ hallucinate

Tool Calling กับ MCP ต่างกันยังไง?

ถ้าคุณเคยใช้ Claude, ChatGPT, หรือ Cursor มาก่อน อาจจะคุ้นกับคำว่า MCP (Model Context Protocol) และอาจเข้าใจว่า Tool Calling = การเรียกใช้ tools จาก MCP

จริงๆ แล้วไม่ใช่แบบนั้นครับ — MCP เป็นแค่ วิธีหนึ่ง ในการส่ง tools ให้ LLM เท่านั้น

Tool Calling (concept กว้าง — มีมาก่อน MCP)

│

├── Custom Tools

│ นักพัฒนาเขียนฟังก์ชันเองแล้วส่งให้ LLM ใช้

│ เช่น get_weather(), send_email(), query_database()

│

├── Built-in Tools

│ tools ที่ platform เตรียมให้อยู่แล้ว

│ เช่น web search, code interpreter ใน ChatGPT

│

└── MCP Tools ← MCP อยู่ตรงนี้

tools ที่มาจาก MCP server

เช่น Gmail MCP, Slack MCP, Figma MCPMCP คืออะไร? MCP คือ มาตรฐานกลาง ที่ Anthropic สร้างขึ้น เพื่อให้การเชื่อมต่อ tools กับ LLM มีรูปแบบที่ทุก app ใช้ร่วมกันได้ แทนที่แต่ละเจ้าจะ implement ต่างกัน

ปัจจุบัน MCP แพร่หลายมากจนกลายเป็นมาตรฐานที่ทุก app ใช้ — เลยเป็นเรื่องปกติมากที่จะนึกว่า Tool Calling = MCP

แต่ถ้าจะให้เข้าใจถูกต้อง:

- Tool Calling = concept ของการที่ LLM เรียกใช้ฟังก์ชันได้

- MCP = มาตรฐานที่ทำให้การส่ง tools ให้ LLM เป็นเรื่องง่ายและ consistent

💡 เปรียบได้ว่า Tool Calling เหมือน “แนวคิดการส่งของ” และ MCP เหมือน “มาตรฐานกล่องพัสดุ” ที่ทุกบริษัทขนส่งใช้ร่วมกัน — กล่องมาตรฐานทำให้ส่งของง่ายขึ้น แต่การส่งของมีอยู่ก่อนกล่องมาตรฐานจะเกิดขึ้น

✅ Check Your Understanding — หัวข้อที่ 3

- Tool Calling คืออะไร? อธิบายด้วยภาษาตัวเอง

- ใน Tool Calling — ใครเป็นคนรัน tool จริงๆ? LLM หรือโค้ดรอบนอก?

- ถ้า Developer ไม่ใส่ tool send_email ให้ Agent — Agent ส่ง email ได้ไหม?

- บอก tools 3 อย่างที่ Agent “ที่ช่วยงานออฟฟิศ” ควรมี

เฉลย (คลิกเพื่อดู)

- Tool Calling คือความสามารถของ LLM ในการ “เรียกใช้ฟังก์ชัน” ที่นักพัฒนาเตรียมไว้ เพื่อให้ LLM สามารถกระทำกับโลกภายนอกได้

- โค้ดรอบนอก รัน tool จริงๆ — LLM แค่ “สั่ง” ว่าจะเรียก tool ไหนด้วย parameter อะไร

- ไม่ได้ — Agent ทำได้เฉพาะสิ่งที่มี tool ให้เท่านั้น

- เช่น: read_email, send_email, create_calendar_event, search_files, draft_document ฯลฯ

Summary — Level 0

ยินดีด้วย! คุณผ่าน Level 0 แล้ว 🎉

นี่คือ key takeaway ที่ต้องจำ:

3 สิ่งที่ต้องรู้

1. LLM คือ “สมอง” ของ AI

- Large Language Model — โมเดลที่เรียนรู้จาก text มหาศาล

- สร้างคำตอบ ทีละ token

- ทำได้แค่ “พูด” — ไม่มีมือ ไม่มีตา ไม่มีความจำข้าม session

2. AI Agent ต่างจาก Chatbot ที่ “ลงมือทำได้จริง”

- Chatbot: รับคำถาม → ตอบ → จบ

- AI Agent: รับเป้าหมาย → วางแผน → ใช้ tools → วนซ้ำ → รายงานผล

- Agent มี เป้าหมาย ไม่ใช่แค่ คำถาม

3. Tool Calling คือ “มือ” ของ Agent

- LLM ตัดสินใจว่าจะเรียก tool ไหน

- โค้ดรอบนอกรัน tool จริงๆ

- Agent ทำได้เฉพาะสิ่งที่มี tool ให้เท่านั้น

แผนภาพสรุป

User

│ บอกเป้าหมาย

▼

┌─────────────┐

│ LLM │◄──────────────────┐

│ คิด/วางแผน │ │

└─────────────┘ │ ผลลัพธ์

│ │ กลับมา

│ เรียก Tool │

▼ │

┌─────────────┐ │

│ Tools │───────────────────┘

│ ลงมือทำ │

└─────────────┘

(วนซ้ำจนงานเสร็จ)

│

▼

User

(งานเสร็จ)FAQ — คำถามที่พบบ่อย

Q: AI Agent กับ Chatbot ต่างกันอย่างไร?

Chatbot รับคำถามแล้วตอบเป็นข้อความ — จบในครั้งเดียว ส่วน AI Agent รับเป้าหมายแล้วลงมือทำให้จริงๆ โดยวางแผน เรียกใช้ tools และวนซ้ำจนงานเสร็จ ความต่างหลักคือ Agent “กระทำ” ได้ ไม่ใช่แค่ “พูด”

Q: LLM ทำงานอย่างไร?

LLM หรือ Large Language Model เรียนรู้จากข้อความมหาศาลบนอินเทอร์เน็ต จนสามารถเข้าใจและสร้างภาษาได้ โดยมันสร้างคำตอบทีละ token (ชิ้นส่วนของข้อความ) ไม่ใช่ครั้งเดียวทั้งหมด และแต่ละ token ที่สร้างออกมาจะกลายเป็น input สำหรับ token ถัดไป

Q: Tool Calling คืออะไร และทำไมถึงสำคัญ?

Tool Calling คือความสามารถที่ให้ LLM “เรียกใช้ฟังก์ชัน” ภายนอกได้ เช่น ค้นเว็บ ส่ง email หรือสร้างไฟล์ มันสำคัญเพราะ LLM เองทำได้แค่ตอบเป็นข้อความ — Tool Calling คือ “มือ” ที่ทำให้ Agent ลงมือทำกับโลกภายนอกได้จริง

Q: ควรใช้ AI Agent แทน Chatbot เมื่อไหร่?

ใช้ Chatbot เมื่อต้องการ คำอธิบาย, คำแนะนำ, หรือ draft ข้อความ — ที่คุณต้องรีวิวและดำเนินการเอง ใช้ AI Agent เมื่อต้องการให้งาน “เสร็จจริงๆ” โดยอัตโนมัติ เช่น จองที่พัก, ส่ง email, รวบรวม data จากหลายแหล่ง หรืองานที่มีหลายขั้นตอนต่อเนื่องกัน

Q: LLM กับ AI Agent ต่างกันอย่างไร?

LLM คือ “สมอง” — โมเดลที่เข้าใจและสร้างภาษา ส่วน AI Agent คือ “ระบบ” ที่ใช้ LLM เป็นส่วนหนึ่ง ร่วมกับ tools, memory, และ agent loop เพื่อให้สามารถทำงานที่ซับซ้อนได้ พูดง่ายๆ ว่า LLM ⊂ AI Agent เสมอ แต่ AI Agent ≠ LLM เพียงอย่างเดียว

Q: ข้อผิดพลาดที่พบบ่อยเกี่ยวกับ AI Agent คืออะไร?

ความเข้าใจผิดที่พบบ่อยที่สุดคือคิดว่า ChatGPT หรือ Claude คือ “AI Agent” ทั้งหมด — จริงๆ แล้วมันคือ Chatbot ที่มี LLM อยู่ข้างใน ความแตกต่างคือ AI Agent ต้องมี tools ที่ลงมือทำกับโลกภายนอกได้จริง และต้องมี agent loop ที่วนซ้ำจนงานเสร็จ

ถัดไป — Level 1

ตอนนี้คุณเข้าใจพื้นฐานแล้ว ใน Level 1 เราจะเจาะลึกลงไปว่า AI Agent ตัวเดียวทำงานยังไงข้างใน ประกอบด้วยอะไรบ้าง และออกแบบยังไงให้ดี

หัวข้อที่รออยู่:

- Agent Loop — วงจรการทำงานของ Agent

- ส่วนประกอบของ Agent (Code + Instructions + LLM)

- Context Window Management

- Memory System

- System Prompt Design

- Tool Design

- Permission & Safety Model

พร้อมแล้วก็ไป Level 1 ได้เลย! →

Level 0 — AI Foundation | Multi-Agent Foundation Series อัปเดต: March 2026